* Por Rogério Pires

* Por Rogério Pires

A Inteligência Artificial está transformando o cenário da medicina, oferecendo oportunidades sem precedentes para aprimorar diagnósticos, tratamentos e eficiência operacional. Em paralelo, essa revolução tecnológica também levanta preocupações significativas sobre a segurança do paciente e a confiabilidade das informações fornecidas por essas ferramentas.

Recentemente, muitos médicos começaram a utilizar chatbots de IA, como o ChatGPT, em decisões clínicas. Mesmo sem diretrizes claras ou regulamentação suficiente, uma pesquisa da KFF Health News revelou que 76% dos médicos usam essas ferramentas para verificar interações medicamentosas, suporte ao diagnóstico e planejamento de tratamento. A facilidade de acesso e a capacidade de processamento rápido de informações tornam esses chatbots atraentes para profissionais que enfrentam cargas de trabalho intensas e a necessidade de atualização constante.

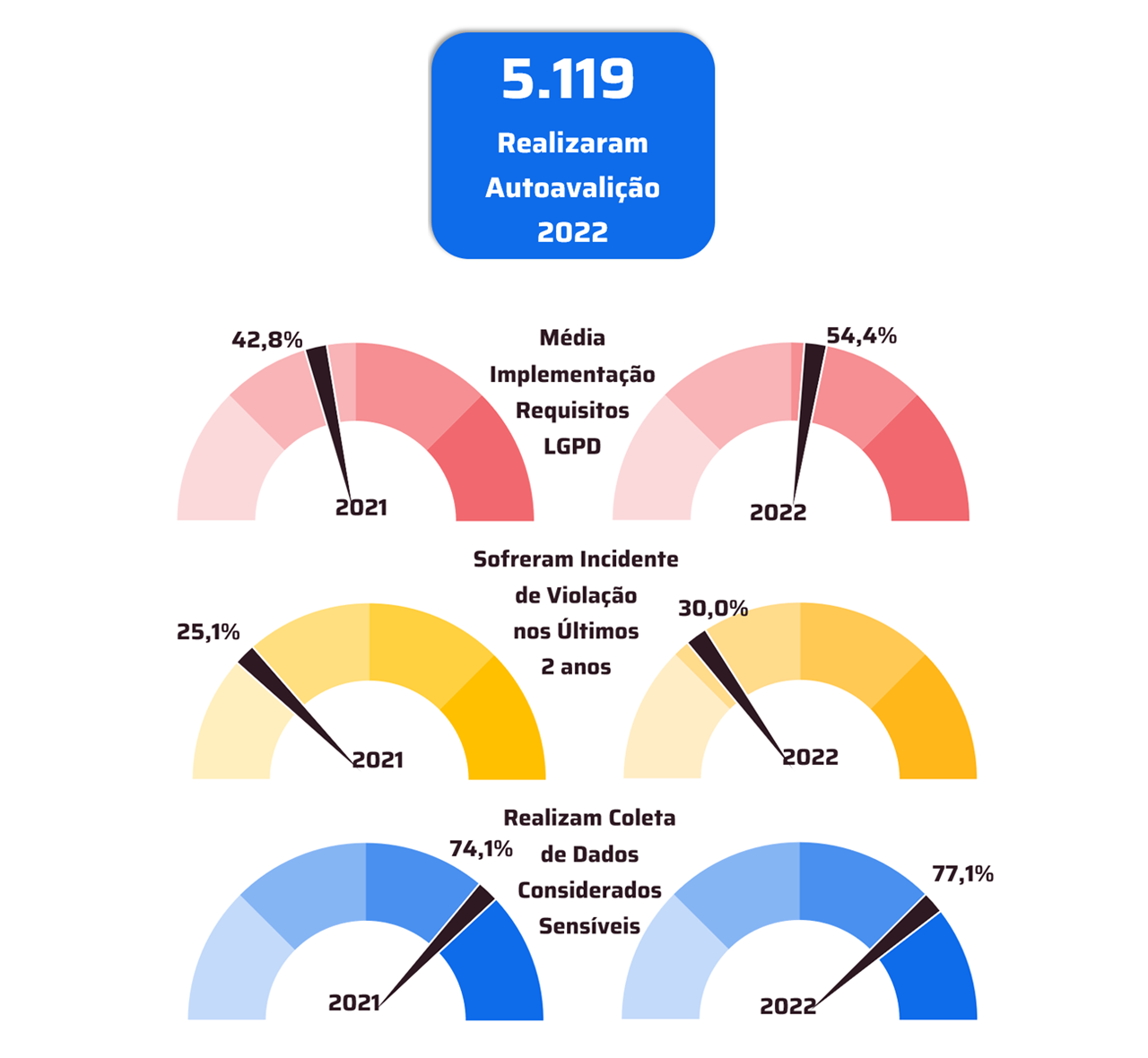

Mas os especialistas alertam para os riscos associados ao uso de sistemas não verificados. Há preocupações legítimas sobre a possibilidade de respostas incorretas, “alucinações” de IA e a falta de conformidade com normas de privacidade de dados de saúde, como a Lei Geral de Proteção de Dados (LGPD) no Brasil. Conforme destacado no artigo da Fierce Healthcare, “esses modelos podem não saber que estão cometendo um erro e, também, não podem lhe dizer isso”, afirmou Graham Walker, M.D., médico de emergência no Kaiser Permanente.

Paralelamente, o autodiagnóstico por IA tornou-se uma preocupação crescente entre os médicos brasileiros. De acordo com uma pesquisa da Medscape, 83% dos profissionais apontam que os pacientes correm riscos ao utilizarem a Inteligência Artificial para autodiagnóstico. A facilidade de acesso a chatbots públicos e aplicativos de saúde alimentados por IA, podem levar pacientes a interpretarem erroneamente sintomas e retardarem a busca por atendimento médico adequado.

Essa situação complexa ressalta a necessidade de uma reflexão profunda sobre o papel da IA na saúde. A Inteligência Artificial sempre vai fornecer uma resposta, independentemente de sua veracidade. E, se ela errar, ainda assim, vai tentar nos convencer de que está certa, o que é particularmente perigoso. Isso reforça a importância do julgamento clínico e da necessidade de os profissionais estarem cientes das limitações dessas tecnologias.

Diante desse cenário, é fundamental que a integração da IA na medicina seja feita de forma responsável e ética. Aqui, entra a importância de se contar com parceiros de tecnologia confiáveis que garantam a qualidade dos softwares e a segurança das informações dos pacientes. Já existem soluções tecnológicas robustas e seguras, alinhadas às necessidades do setor e em conformidade com as regulamentações vigentes.

Ao optar por parceiros tecnológicos sólidos, as instituições de saúde podem assegurar que as ferramentas de IA sejam utilizadas como aliadas, potencializando a eficiência e a precisão nos cuidados com os pacientes. Assim, é possível aproveitar os benefícios da IA na medicina, garantindo que a tecnologia esteja a serviço do cuidado humano e da segurança do paciente.

*Rogério Pires, diretor de produtos para Saúde da TOTVS

Aviso: A opinião apresentada neste artigo é de responsabilidade de seu autor e não da ABES – Associação Brasileira das Empresas de Software